Le calendrier que tout DirCom doit connaître aujourd’hui

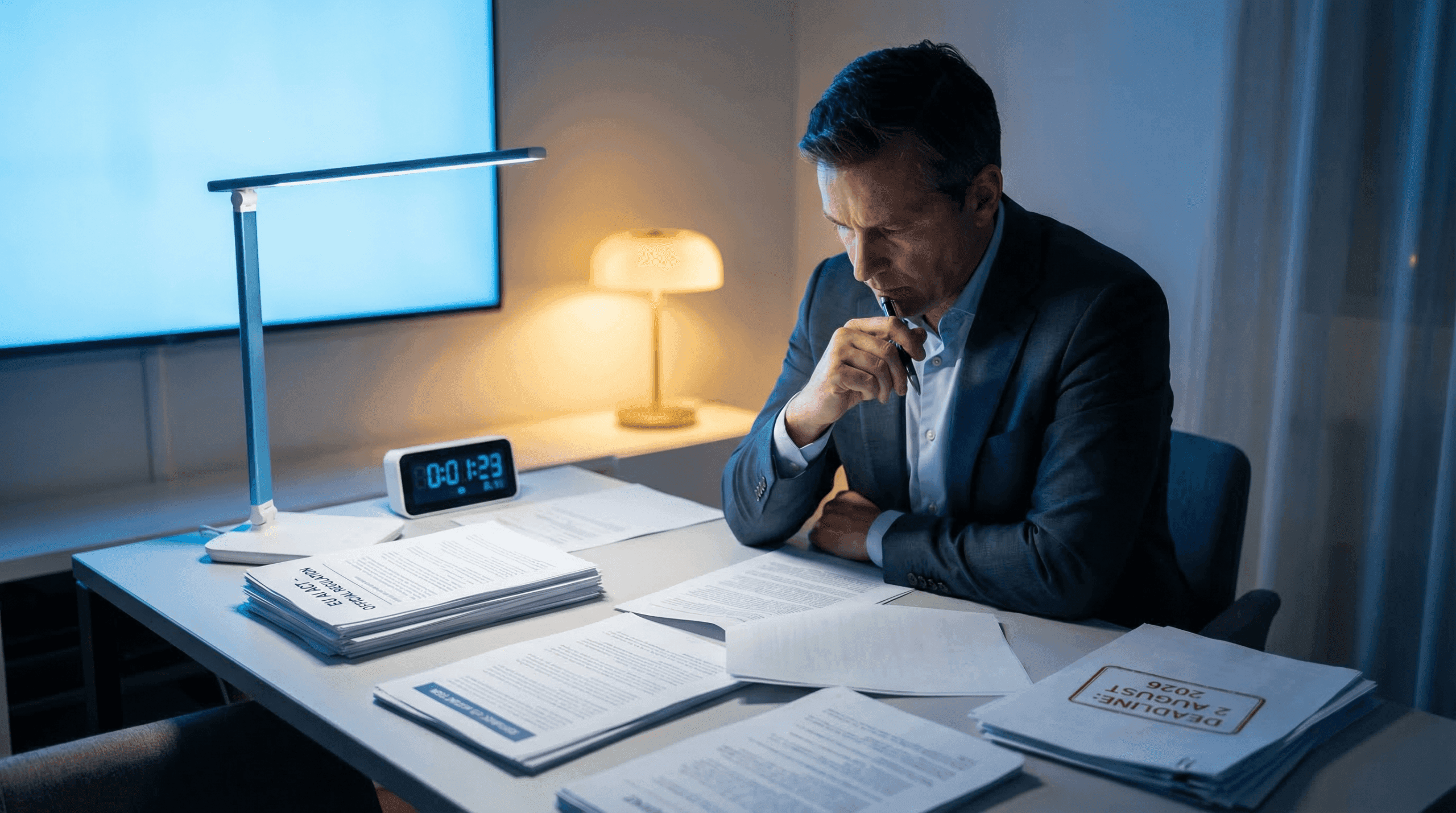

L’AI Act, Règlement (UE) 2024/1689, est entré en vigueur le 1er août 2024. Son application est progressive et son calendrier doit être lu comme une série de deadlines, pas comme une entrée en vigueur unique. Pour les directeurs de la communication, directeurs marketing et équipes contenu, une date domine toutes les autres : le 2 août 2026.

C’est à cette date que l’Article 50 du règlement entre en vigueur. Cet article établit les obligations de transparence qui touchent directement toute organisation utilisant des systèmes d’IA pour produire du contenu, interagir avec des utilisateurs ou diffuser des communications numériques. Son champ d’application est délibérément large : il ne concerne pas seulement les développeurs d’IA. Il concerne toute entreprise qui déploie un système d’IA capable de générer du texte, de l’image, de l’audio ou de la vidéo.

| Date | Obligation | Qui est concerné |

|---|---|---|

| 1 août 2024 | Entrée en vigueur du règlement | Tous |

| 2 février 2025 | Pratiques interdites (scoring social, manipulation subliminal) + obligations de littératie IA | Tous |

| 2 août 2025 | Obligations des modèles GPAI (GPT-4, Claude, Gemini…) : documentation, transparence droits d’auteur, risques systémiques | Fournisseurs de modèles IA généraux |

| 2 août 2026 | Article 50 : obligations de transparence sur le contenu IA. Systèmes à haut risque (Annexe III) si Digital Omnibus non adopté | Tout déployeur de système IA génératif · DirCom en première ligne |

| Juin 2026 | Publication du Code de pratique final sur le marquage des contenus IA (référence de conformité Article 50) | Tous les déployeurs d’IA générative |

| 2 décembre 2027 | Date butoir maximale pour les systèmes à haut risque Annexe III (si Digital Omnibus adopté) | Systèmes IA dans RH, crédit, éducation, forces de l’ordre |

Une précision critique sur le Digital Omnibus : en novembre 2025, la Commission européenne a proposé un paquet de simplification (Digital Omnibus) qui conditionne l’entrée en vigueur des obligations sur les systèmes à haut risque à la disponibilité des normes harmonisées, repoussant leur échéance maximale à décembre 2027. Mais l’Article 50 sur la transparence du contenu IA n’est pas concerné par ce report. Il reste applicable au 2 août 2026. Le Digital Omnibus prévoit seulement un délai de grâce de 6 mois pour les systèmes déjà sur le marché avant cette date concernant le watermarking machine-readable, soit jusqu’au 2 février 2027. Pour tous les nouveaux systèmes et toutes les autres obligations de transparence, la deadline du 2 août 2026 est maintenue.

Ce que l’Article 50 exige concrètement des équipes communication

L’Article 50 du Règlement (UE) 2024/1689 établit quatre obligations de transparence distinctes. Chacune a des implications directes pour les équipes communication et marketing.

Obligation 1 : divulgation des systèmes d’IA conversationnels. Tout système d’IA capable d’interagir directement avec une personne physique (chatbot, assistant virtuel, agent conversationnel) doit informer l’utilisateur qu’il interagit avec une machine, et non avec un humain. Cette obligation concerne le chatbot de votre site web, votre assistant clientèle automatisé, votre outil de réponse aux emails. Exception : quand l’utilisation de l’IA est « évidente au regard du contexte » ou quand elle sert des finalités légales d’application de la loi. Pour la communication d’entreprise standard, cette exception ne s’applique pas.

Obligation 2 : marquage machine-readable des contenus IA générés. Les fournisseurs de systèmes d’IA générative doivent s’assurer que leurs outputs (texte, image, audio, vidéo) sont marqués dans un format lisible par machine, permettant de détecter qu’ils ont été générés ou manipulés par une IA. Pour les déployeurs (vous), l’obligation principale sera de vous assurer que les outils que vous utilisez respectent cette exigence technique. Le Code de pratique en cours d’élaboration prévoit un système de watermarking et de métadonnées de provenance. Le 2e projet du Code de pratique, publié le 5 mars 2026, supprime la distinction entre contenu « entièrement IA » et « assisté par IA » : tout sera étiqueté de la même façon.

Obligation 3 : étiquetage visible des deepfakes. Tout contenu « deepfake » (audio, visuel ou audiovisuel représentant de manière réaliste des personnes, lieux ou événements n’existant pas ou altérés) doit être signalé de façon claire et distincte dès la première exposition. Pour une vidéo non en temps réel : une icône visible accompagnée d’un avertissement en début de vidéo. En attendant l’icône commune européenne définitive, le Code de pratique prévoit une solution intermédiaire : un label visuel avec l’acronyme « IA » en français. Exception limitée : les oeuvres manifestement artistiques, créatives ou satiriques bénéficient d’un régime allégé, mais l’exemption totale n’existe pas.

Obligation 4 : divulgation des textes IA sur des sujets d’intérêt public. Tout texte généré par IA et publié dans le but d’informer le public sur des questions d’intérêt public doit être clairement signalé comme généré par une IA. C’est ici que se trouve l’exception stratégique dont nous parlons plus loin.

Fournisseur ou déployeur : la distinction qui change tout

L’AI Act distingue deux rôles fondamentaux dans la chaîne de valeur de l’IA. Cette distinction détermine vos obligations spécifiques.

Le fournisseur est l’organisation qui développe le système d’IA et le met sur le marché. OpenAI pour ChatGPT, Anthropic pour Claude, Adobe pour Firefly. Les fournisseurs ont les obligations les plus lourdes : documentation technique, watermarking des outputs, tests de robustesse, conformité aux droits d’auteur.

Le déployeur est l’organisation qui utilise un système d’IA existant dans le cadre de ses activités professionnelles. C’est le cas de la grande majorité des entreprises qui utilisent ChatGPT, Claude, Midjourney, Copilot ou tout autre outil IA pour produire du contenu, gérer leurs communications ou interagir avec leurs clients. Les déployeurs ont des obligations plus légères, mais elles ne sont pas nulles, notamment sur la transparence visible (étiquetage deepfakes, divulgation chatbot, signalement des textes d’intérêt public).

Le piège fréquent : beaucoup d’entreprises sont simultanément fournisseurs et déployeurs pour différents systèmes. Une ETI qui utilise ChatGPT pour ses communications (déployeur) et qui a développé en interne un outil IA de traitement des commandes (fournisseur) est soumise aux deux régimes. La cartographie des usages IA est donc la première étape indispensable, bien avant de parler de conformité.

L’exception que chaque DirCom doit connaître : le contrôle éditorial humain

L’Article 50, alinéa 4, contient une clause qui a reçu peu d’attention médiatique mais qui est stratégiquement fondamentale pour toute organisation produisant du contenu.

L’obligation d’étiqueter un texte généré par IA publié à des fins d’information du public ne s’applique pas lorsque le contenu a fait l’objet d’un processus d’examen humain ou de contrôle éditorial et lorsqu’une personne physique assume la responsabilité éditoriale de ce contenu.

En d’autres termes : si un humain relit, modifie, valide et assume la responsabilité d’un texte partiellement généré par IA avant publication, l’étiquetage obligatoire « contenu généré par IA » ne s’applique pas.

Cette exception n’est pas une faille. C’est une reconnaissance explicite par le législateur européen que le travail éditorial humain change la nature du contenu. Un texte qui passe par un filtre éditorial humain sérieux n’est plus un contenu IA : c’est un contenu humain assisté par IA. La distinction est fondamentale, légalement reconnue, et créatrice de valeur.

Les implications pour les équipes communication sont directes. Toute organisation qui met en place des processus de relecture et de validation humaine de ses contenus IA dispose d’un double avantage : elle se conforme à l’exception légale de l’Article 50 et elle produit des contenus dont la qualité éditoriale est garantie par une responsabilité humaine identifiée. Ce n’est pas simplement de la conformité. C’est une stratégie de positionnement.

Le cabinet d’avocats Bird & Bird pointe une implication supplémentaire dans son analyse du Code de pratique : la classification d’un contenu comme « entièrement généré par IA » a des conséquences sur la protection par le droit d’auteur en droit européen, qui requiert une contribution créative humaine. Un contenu classifié « entièrement IA » peut être considéré comme libre de droits, ce qui permettrait à vos concurrents de le réutiliser sans restriction. Un contenu classifié « assisté par IA » avec contrôle éditorial humain documenté préserve la protection par le droit d’auteur. La décision de documenter ou non votre processus éditorial humain a donc des conséquences à la fois réglementaires et commerciales.

Le Code de pratique : gouverner par le code volontaire qui devient opposable

L’AI Act prévoit explicitement le développement de codes de pratique volontaires pour faciliter la mise en conformité avec l’Article 50. Le Bureau de l’IA de la Commission européenne a lancé en novembre 2025 un processus de rédaction associant plus de 200 parties prenantes (fournisseurs IA, associations de déployeurs, ONG, experts académiques). Un premier projet a été publié le 17 décembre 2025. Un deuxième projet a été publié le 5 mars 2026. Le code final est attendu pour juin 2026, avant l’entrée en vigueur de l’Article 50 en août.

Ce code est « volontaire ». Dans les faits, il ne l’est pas vraiment. Plusieurs analyses juridiques (Jones Day, Bird & Bird, Pearl Cohen) convergent sur ce point : le Code de pratique deviendra la référence principale utilisée par les régulateurs et les tribunaux pour évaluer si une organisation remplit ses obligations au titre de l’Article 50. Une organisation qui ne s’y conforme pas, ou qui ne peut pas présenter un système équivalent, s’expose à un examen renforcé de la part des autorités nationales compétentes.

C’est ce que nous appelons chez ELMARQ « gouverner par le code » : le mécanisme par lequel un instrument volontaire acquiert une force quasi-obligatoire parce qu’il devient la référence de ce que les régulateurs considèrent comme une bonne pratique. L’AI Act n’est pas le premier règlement à fonctionner ainsi : le RGPD a suivi le même chemin avec ses lignes directrices du Comité européen de la protection des données.

Pour les équipes communication, cela signifie que la conformité ne s’arrête pas au texte du règlement. Elle inclut l’alignement avec le Code de pratique, même avant sa finalisation. Les organisations qui participent activement à sa rédaction ou qui s’alignent précocement sur ses orientations auront une longueur d’avance réglementaire et réputationnelle.

Les sanctions : ce que les dirigeants doivent comprendre avant le conseil d’administration

L’AI Act prévoit plusieurs niveaux d’amendes administratives selon la gravité de l’infraction.

Pour les violations des obligations de transparence de l’Article 50 (la non-divulgation d’une interaction IA, le défaut d’étiquetage d’un deepfake, l’absence de mention sur un texte IA d’intérêt public) : amendes jusqu’à 15 millions d’euros ou 3 % du chiffre d’affaires mondial annuel, le montant le plus élevé étant retenu.

Pour les violations graves (non-respect des obligations pour les systèmes à haut risque, usages interdits) : amendes jusqu’à 35 millions d’euros ou 7 % du chiffre d’affaires mondial annuel.

Pour les informations incorrectes ou trompeuses fournies aux autorités : jusqu’à 7,5 millions d’euros ou 1 % du chiffre d’affaires.

En France, les autorités chargées de la supervision sont la CNIL (protection des données), la DGCCRF (pratiques commerciales) et l’Arcom (contenus en ligne et audiovisuels). Ces autorités exercent déjà des compétences qui recoupent plusieurs obligations de l’AI Act. Les entreprises ayant des antécédents en matière de RGPD ou de DSA se retrouveront sous la surveillance d’autorités qui connaissent déjà leurs pratiques.

Un point spécifique pour les PME et ETI : le Digital Omnibus étend les dispositions simplifiées de conformité au système de gestion de la qualité (Article 17) aux petites et moyennes entreprises, qui n’en bénéficiaient auparavant que pour les microentreprises. C’est une mesure concrète d’allègement qui réduit le coût de la mise en conformité pour les structures de taille intermédiaire.

L’asymétrie du risque : pourquoi certaines entreprises sortent renforcées d’une deadline réglementaire

Toute deadline réglementaire crée une asymétrie. Certaines organisations la subissent : elles s’y conforment à minima, en retard, sous contrainte, avec le sentiment que la réglementation est un fardeau. D’autres l’anticipent : elles s’y conforment en avance, en faisant de la conformité un signal de confiance auprès de leurs audiences.

Pour les équipes communication, cette asymétrie a une dimension supplémentaire. L’AI Act crée un marqueur de différenciation que peu d’entreprises ont encore exploré : la visibilité du contrôle éditorial humain comme preuve de qualité.

Imaginez deux entreprises du même secteur. La première étiquette tous ses contenus « généré par IA » parce qu’elle n’a pas mis en place de processus de validation humaine. La seconde a documenté un processus de relecture et de responsabilité éditoriale qui lui permet d’invoquer l’exception de l’Article 50 et de publier sans étiquetage obligatoire. Dans l’esprit des audiences habituées à lire des milliers de contenus IA, le contenu de la seconde entreprise sera perçu, inconsciemment ou explicitement, comme plus fiable.

Ce mécanisme n’est pas hypothétique. Il est documenté par les données de confiance que nous avons analysées dans notre article sur la Fatigue Synthétique : les consommateurs accordent une valeur nouvelle à l’authenticité en 2026 comme prérequis d’engagement. L’AI Act codifie légalement ce que le marché exprime déjà socialement.

Les organisations qui construisent leur processus éditorial humain maintenant, avant la deadline, ne se contentent pas de se conformer. Elles se positionnent dans la catégorie des émetteurs de contenu fiables au moment précis où cette catégorie prend de la valeur relative.

Le plan d’action en 5 étapes pour les DirCom avant août 2026

Étape 1 : cartographier les usages IA éditoriaux. Inventoriez tous les outils IA utilisés par vos équipes pour produire du contenu : rédaction, images, vidéos, audio, emails automatisés, chatbots, réponses réseaux sociaux. Pour chaque outil, identifiez si vous êtes fournisseur (vous l’avez développé) ou déployeur (vous utilisez un service tiers). Cette cartographie doit inclure la « Shadow AI » : les outils utilisés par les équipes sans autorisation formelle de la direction. Une étude Workday de janvier 2026 rappelle que 89 % des organisations n’ont pas mis à jour leurs processus pour refléter les usages IA réels. Votre cartographie révélera probablement des angles morts.

Étape 2 : identifier vos contenus d’intérêt public. L’obligation d’étiquetage des textes IA s’applique aux textes « publiés dans le but d’informer le public sur des questions d’intérêt public ». Cette définition est large. Elle couvre potentiellement vos communiqués de presse, vos prises de position publiques, vos contenus sur des sujets de santé, d’environnement, d’économie ou de politique. Pour ces contenus, vous avez deux options : étiqueter explicitement, ou documenter un processus de contrôle éditorial humain permettant d’invoquer l’exception légale.

Étape 3 : formaliser un processus de contrôle éditorial humain. Ce processus doit être documenté, pas seulement pratiqué. Il doit identifier une personne physique responsable de chaque contenu publié, préciser les étapes de relecture et de validation, et laisser des traces consultables (historique d’édition, validation, signature). Ce n’est pas un document administratif : c’est votre preuve de conformité à l’exception Article 50 et votre protection en cas de contrôle.

Étape 4 : auditer vos chatbots et agents conversationnels. Tous vos systèmes d’IA conversationnels doivent informer les utilisateurs qu’ils interagissent avec une machine. Si votre chatbot se présente sous un prénom humain sans mention de sa nature artificielle, vous êtes en infraction au 2 août 2026. Vérifiez également vos outils de réponse automatique aux emails clients : s’ils sont capables de mener une conversation, ils sont concernés.

Étape 5 : suivre le Code de pratique et ses évolutions. Le 2e projet a été publié le 5 mars 2026. La version finale est attendue en juin 2026. Chaque mise à jour précise les obligations pratiques de marquage, d’étiquetage et de divulgation. Désignez un responsable interne qui suit ces évolutions et les traduit en procédures opérationnelles pour vos équipes.

Ce que la conformité AI Act dit de votre positionnement éditorial

La conformité à l’AI Act n’est pas seulement un exercice juridique. Elle est un révélateur de stratégie éditoriale.

Une organisation qui étiquette massivement ses contenus « généré par IA » envoie un message à ses audiences : elle produit du contenu IA non supervisé à grande échelle. C’est conforme. C’est aussi un signal qui, dans le contexte actuel de Fatigue Synthétique, peut fragiliser la confiance.

Une organisation qui a mis en place des processus éditoriaux humains robustes et qui peut invoquer l’exception Article 50 envoie un message différent : elle utilise l’IA comme outil, pas comme auteur. Elle maintient une responsabilité humaine sur ses prises de parole publiques. Dans un environnement informationnel saturé de contenu synthétique, ce positionnement est rare et précieux.

L’AI Act, lu sous cet angle, n’est pas une contrainte extérieure imposée à votre stratégie de contenu. Il est une infrastructure réglementaire qui récompense les organisations ayant investi dans la qualité éditoriale humaine avant que ce choix ne devienne obligatoire pour les autres.

Les DirCom qui comprennent cette logique maintenant ont jusqu’en août 2026 pour bâtir leur avantage. Ceux qui attendront la deadline pour s’y conformer construiront leur conformité dans l’urgence, sans en tirer de bénéfice stratégique.

Vous utilisez des outils IA pour produire du contenu et vous ne savez pas encore si vos processus vous permettent d’invoquer l’exception « contrôle éditorial humain » de l’Article 50 ? L’audit Empreinte Narrative IA ELMARQ cartographie vos usages IA éditoriaux, identifie vos zones de risque réglementaire et vous aide à construire la stratégie de conformité qui renforce votre positionnement plutôt que de le fragiliser. 60 minutes. Prenez contact sur elmarq.fr.

AI Act, Article 50, DirCom et conformité août 2026 : sources officielles et analyses juridiques

Sources & références

- Commission européenne · « Législation sur l’IA » · calendrier officiel d’application · AI Act Article 50 · Digital Omnibus

- Commission européenne · Code de pratique sur le marquage des contenus IA · WG1 + WG2 · calendrier rédaction 2025-2026

- EU Artificial Intelligence Act · Article 50 : Transparency Obligations · texte officiel

- Aiacto · « Article 50 AI Act : Obligations de Transparence sur les Contenus IA » · 2e projet Code de pratique mars 2026

- Jones Day · « European Commission Publishes Draft Code of Practice on AI Labelling and Transparency » (janvier 2026)

- Bird & Bird · « Taking the EU AI Act to Practice » · implications droit d’auteur « entièrement IA » vs « assisté par IA » (2026)

- Taylor Wessing · « The Digital Omnibus changes to the AI Act » · délai watermarking Article 50(2) (février 2026)

- Cooley · « EU AI Act: Proposed Digital Omnibus on AI » · impact sur les roadmaps de conformité (novembre 2025)

- MDP Data Protection · « AI Act 2026 : obligations, risques et mise en conformité » · CNIL DGCCRF Arcom · amendes

- Service Public Entreprendre · « AI Act : quels changements pour les entreprises ? » · obligations 2 août 2026

- Village de la Justice / Me Tommaso Stella · « Conformité à l’AI Act : l’obligation de transparence de l’article 50 » · exceptions · mars 2026

- Workday · « Beyond Productivity: Measuring the Real Value of AI » (janvier 2026) · 89 % organisations sans processus IA mis à jour